С появлением искусственного интеллекта процесс копирайтинга, то есть написания текстового контента для нужд заказчиков, в корне изменился. Теперь достаточно собрать небольшую "базу данных" для нового проекта, состоящую из "статей-доноров" – на основе которых будет написана наша статья. После этого подобрать ИИ-модель и задать ей правильные вопросы. Последнее является перспективным направлением – некоторые даже называют промпт-инжиниринг профессией будущего.

Сегодня мы поговорим о том, как можно уменьшить время на подготовительную работу – копирование текста с сайтов-доноров. Продвинутые пользователи наверняка догадались, что говорить будем о процессе парсинга.

Простенький парсер на Питоне и искусственном интеллекте

Я заканчивал физмат, однако не являюсь профессиональным программистом, имею о процессе программирования довольно поверхностное представление. Поэтому решил спросить у искусственного интеллекта – напиши мне парсер, который будет забирать статьи по заданным URL и класть их в заранее определенную папку.

Скажу сразу – получилось не сразу. Сначала ИИ выдал такое:

Скрипт не запускался – оказалось что в терминале надо было запустить 2 команды:

pip install requests

pip install beautifulsoup4

Далее – была ошибка ConnectTimeoutError. Сервер сбрасывал соединение раньше, чем парсер успевал скачать статью.

Искусственный интеллект предложил улучшение:

response = requests.get(url, timeout=10) # Устанавливает тайм-аут соединения на 10 секунд

Были проблемы с отображением: скачанные статьи отображались "крякозябрами".

Решение – явно указать кодировку:

def parse_article(url):

response = requests.get(url)

response.encoding = 'utf-8' # Явно указываем кодировку как UTF-8

soup = BeautifulSoup(response.text, 'html.parser')

title = soup.find('h1').text.strip()

paragraphs = soup.find_all('p')

текст = '\n'.join([p.text.strip() for p in paragraphs])

return title, text

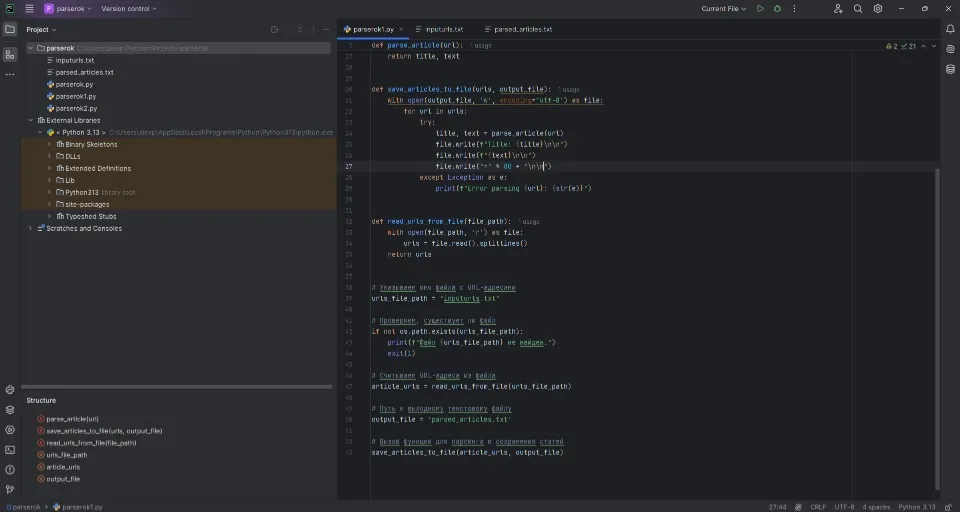

В конце получился такой результат:

Что нужно ещё сделать?

Для того, чтобы вся эта "машинерия" работала, нужно создать новый Python-проект в программе PyCharm. В каталоге проекта создать 2 текстовых файла – inputurls.txt и parsed_articles.txt. В первый файл положите ссылки, с которых надо спарсить статьи, а во втором –будут статьи с ваших доноров.

Для чего это все нужно?

Скриптом я парсил гороскопы, лунные календари и приметы на каждый день. Далее это все отправляется в ИИ, формируется промпт – и на выходе 1 содержательная, а главное полезная для пользователя статья.

Скрипт экономит время, которое нужно на копирование текста с доноров. Например тут более 2 десятков ссылок. Копировать все это вручную довольно скучно).

И еще – работа скрипта на других сайтах, кроме указанного, не гарантируется. Цель этой статьи показать, чего можно достичь с помощью синергии программирования и искусственного интеллекта. Даже больше – если хорошо понимать программирование, то и горы можно свернуть). Жду ваших комментариев!